Искусственный интеллект Facebook может анализировать мемы, но сможет ли он их понять? Технология Rosetta от Facebook анализирует миллиарды изображений, содержащих текст, но мемы слишком сложны для искусственного интеллекта. Ежедневно в социальные сети загружаются миллиарды текстов, фотографий и видео. Это огромное количество информации, которую модераторы-люди и их проверяющие факты не могут всесторонне проанализировать, контролировать и контролировать. Такие компании, как Facebook и YouTube, уже давно полагаются на искусственный интеллект, чтобы защитить свои платформы от спама, насилия, критического контента и порнографии!

Что-то вроде системно-критического мема без текста может быть сложно проанализировать и обработать его суперкомпьютерам и их алгоритмам, поскольку эта задача требует одновременного расчета нескольких различных визуальных элементов. Автоматизированные системы, так называемые бот-системы, должны распознавать и «читать» слова над фотографией, а также анализировать и присваивать само изображение. Мемы также можно охарактеризовать как сложные культурные артефакты, которые трудно понять вне контекста. Несмотря на проблемы, которые они создают, все основные социальные платформы уже используют ИИ для управления мемами, включая Facebook, который использует инструмент под названием Rosetta для анализа фотографий и видео, содержащих текст и подписи.

По данным Facebook, Rosetta уже используется для автоматического обнаружения контента, нарушающего правила разжигания ненависти. С помощью Rosetta Facebook стремится контролировать пользовательский контент, включая фотографии и видео, а не только текстовые публикации. Rosetta поддерживает процесс, в ходе которого автоматически проверяется, были ли ранее изображения и видео, содержащие текст, помечены как «критические». Rosetta сочетает в себе технологию OCR (оптического распознавания символов) с другими методами машинного обучения для просмотра, обработки, классификации и назначения текста на фотографиях и видео, а также его последующего сохранения. Во-первых, OCR используется для определения того, где находится текст в меме или видео. Это позволяет им быстро преобразовывать данные и использовать свои «селекторы» для оценки контента.

Как только Розетта узнает, где находятся слова, Facebook использует нейронную сеть, которая может понять текст, его транскрипцию и значение. Затем этот текст можно передать через другие системы, например систему, которая проверяет, является ли мем вирусным сообщением, которое уже было опровергнуто в соответствии с их рекомендациями. Разработчики и исследователи Rosetta утверждают, что теперь инструмент может извлекать текст из любого изображения, публично загруженного в Facebook, в режиме реального времени, распознавать текст, а также «читать» его языковой идентификатор, включая английский, испанский, немецкий и арабский.

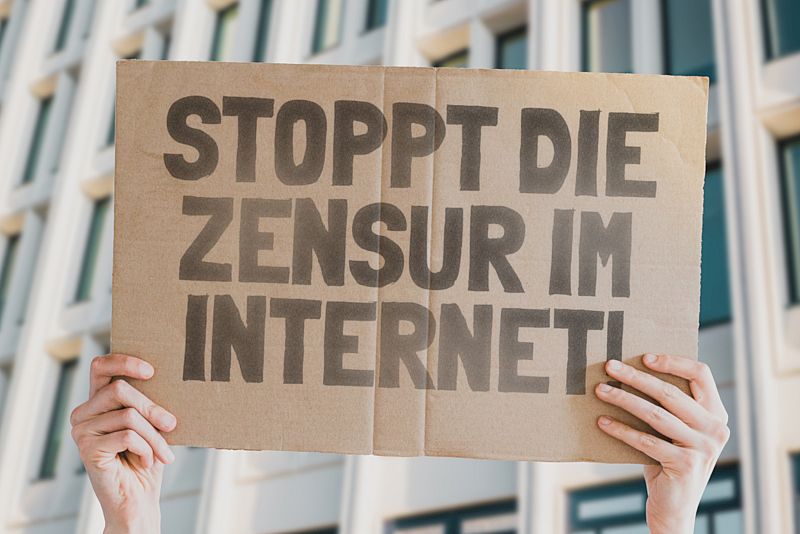

Rosetta также может анализировать изображения, содержащие текст в самых разных формах, например фотографии знаков протеста, меню ресторанов, витрин магазинов и многое другое. Вишванат Сивакумар, инженер-программист Facebook, работающий над Rosetta, сообщил в электронном письме, что этот инструмент хорошо работает как для идентификации текста в ландшафте, например, дорожного знака, так и для мемов — но последнее сложнее. «В контексте активного выявления разжигания ненависти и другого контента, нарушающего политику, изображения в стиле мемов представляют собой более сложную задачу для ИИ», — написал он.

В отличие от людей, ИИ обычно необходимо просмотреть десятки тысяч примеров, прежде чем он сможет научиться выполнять сложную задачу, говорит Сивакумар. Но мемы не поддаются бесконечному контролю, даже для Facebook, и сбор и хранение достаточного количества примеров на разных языках и с разными эмоциями также может оказаться затруднительным. Поиск высококачественных сообщений является постоянной проблемой для исследований искусственного интеллекта в более широком смысле. Часто данные необходимо тщательно помечать и архивировать вручную. Многие базы данных также защищены авторским правом.

Чтобы снабдить Rosetta необходимыми данными и обучить их полезности, текст вместе с подписями и местами, из которых они были опубликованы, объединяются в вычислительный процесс. Проще говоря, вы создали программу для создания именно тех примеров, содержание которых кажется сомнительным. Это означает, что весь процесс в некоторой степени автоматизирован: одна программа автоматически выдаёт мемы, а другая пытается их проанализировать. ИИ столкнется с очень большими проблемами. Например, Rosetta сталкивается с такими языками, как арабский, который читается справа налево, в отличие от других языков, таких как английский или немецкий. Розетта «читает» арабский язык задом наперед, а затем после обработки Facebook меняет местами символы. Этот трюк работает на удивление хорошо и позволяет создать унифицированную модель, которая работает как для языков с письмом слева направо, так и с письмом справа налево.

Автоматизированные системы могут быть чрезвычайно полезны для модерации контента и проверки фактов, но это не всегда легко. Например, WeChat использует два разных алгоритма для фильтрации изображений. Первая, программа на основе оптического распознавания символов, фильтрует фотографии, содержащие текст на запрещенные темы, в то время как другие подвергают цензуре изображения, похожие на те, что находятся в черном списке, вероятно, созданном китайским правительством. С помощью фильтров WeChat вы можете легко удалить характеристики изображения, а также цвет или измененную ориентацию. Rossetta от Facebook сложна, но, вероятно, не идеальна. Систему можно обойти с помощью трудночитаемого текста или искаженных шрифтов. Все алгоритмы распознавания изображений по-прежнему потенциально уязвимы к противоречивым примерам: слегка измененным изображениям, которые для людей выглядят одинаково, но запутывают ИИ.

Facebook и другие платформы, такие как Twitter, YouTube и Reddit, находятся под огромным давлением с целью контролировать определенные типы контента в нескольких странах. В 2018 году Европейский Союз предложил новые законы, которые потребуют от социальных сетей удалять посты террористов в течение часа после уведомления, иначе им грозят штрафы. Rosetta и другие подобные автоматизированные инструменты уже помогают Facebook и другим платформам соблюдать аналогичные законы в таких странах, как Германия. И они становятся лучше в своей работе: два года назад генеральный директор Марк Цукерберг заявил, что системы искусственного интеллекта Facebook активно перехватывают только около половины контента, удаленного компанией. Люди должны сначала отметить остальное. По данным Facebook, его инструменты искусственного интеллекта обнаруживают почти 100 процентов спама, который они осуждают, а также 99,5 процентов террористического контента и 86 процентов изображений насилия. Другие платформы, такие как YouTube, добились аналогичного успеха с помощью автоматизированных систем распознавания контента.

Однако это не означает, что системы искусственного интеллекта, такие как Rosetta, являются идеальным решением, особенно когда речь идет о более тонких формах выражения. В отличие от ресторанного меню, проанализировать значение мема может быть сложно, не зная контекста, в котором он был опубликован. Вот почему существуют целые сайты, объясняющие их. Мемы часто содержат шутки или очень специфичны для определенной онлайн-субкультуры и ее моральной и этической основы. А искусственный интеллект до сих пор не способен понять мем или видео так, как это сделал бы человек. На данный момент Facebook по-прежнему придется полагаться на модераторов и их проверщиков фактов, чтобы принимать решения об удалении мема.

Перевод статьи из журнала Wired 14.09.2018 сентября XNUMX г.

(через Вейл Рион)

«Сказки Дрейвена из склепа» вот уже более 15 лет очаровывают безвкусной смесью юмора, серьёзной журналистики – основанной на текущих событиях и несбалансированных репортажах политической прессы – и зомби, приправленных множеством искусства, развлечений и панк-рока. Дрейвен превратил свое хобби в популярный бренд, который невозможно классифицировать.

«Сказки Дрейвена из склепа» вот уже более 15 лет очаровывают безвкусной смесью юмора, серьёзной журналистики – основанной на текущих событиях и несбалансированных репортажах политической прессы – и зомби, приправленных множеством искусства, развлечений и панк-рока. Дрейвен превратил свое хобби в популярный бренд, который невозможно классифицировать.